Notas da comunidade substituem verificação de fatos por moderação de conteúdo

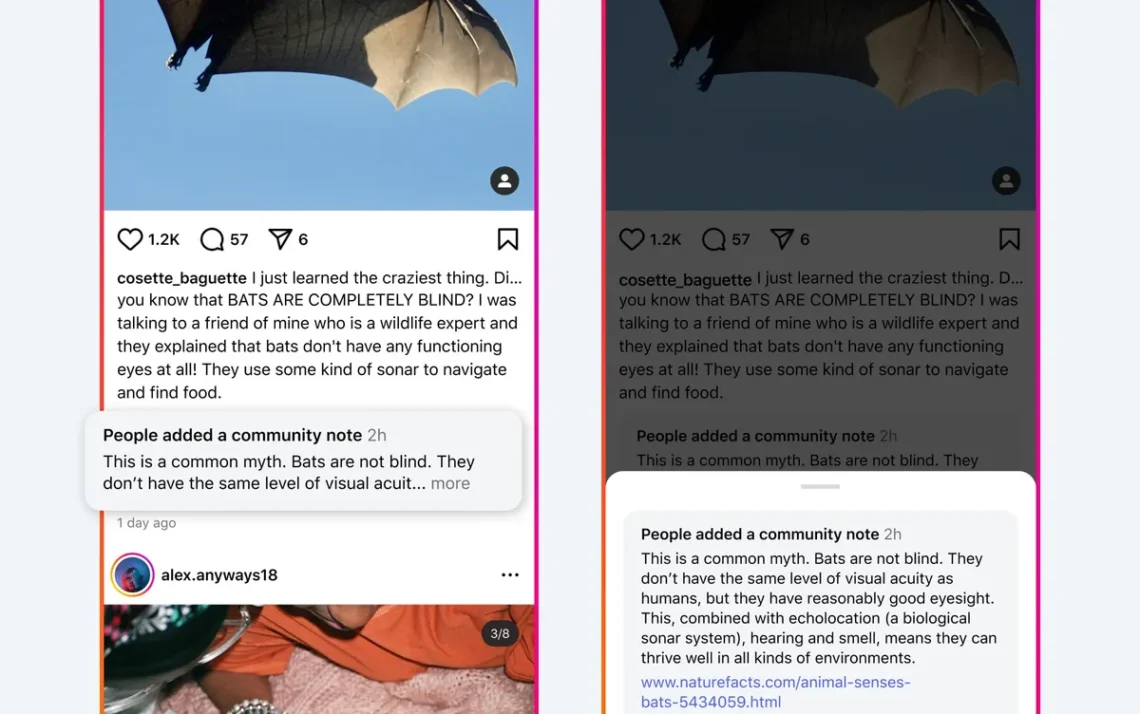

A Meta está prestes a iniciar um novo teste de funcionalidades em sua plataforma, com o objetivo de aprimorar a experiência do usuário. O recurso de ‘notas da comunidade’ será testado na próxima terça-feira (18) no Facebook, Instagram e Threads, e a Meta espera que isso melhore a interação entre os usuários e a Meta. As ‘notas da comunidade’ são uma forma de substituir o programa de verificação de fatos feito por terceiros, o que pode ser um grande passo para a Meta.

A empresa está trabalhando arduamente para implementar essa nova funcionalidade, que será avaliada inicialmente nos Estados Unidos. A plataforma de rede social da Meta será o local onde as ‘notas da comunidade’ serão testadas, e a rede social como um todo pode ser afetada por essa mudança. _É importante notar_ que a Meta está sempre procurando maneiras de melhorar a experiência do usuário, e _isso é um grande passo_ em direção a uma comunidade mais engajada e informada. A Meta espera que as ‘notas da comunidade’ sejam um sucesso e que possam ser implementadas em outras partes do mundo em breve. _A empresa está ansiosa_ para ver os resultados do teste e _otimizar a plataforma_ para atender às necessidades dos usuários.

Introdução à Nova Abordagem da Meta

A Meta, empresa líder em tecnologia, está implementando uma nova abordagem para a moderação de conteúdo em sua plataforma, permitindo que os usuários corrijam informações publicadas de forma semelhante ao modelo implementado pelo X, de Elon Musk. Essa mudança foi anunciada por Mark Zuckerberg, dono da Meta, em um vídeo de 5 minutos publicado no Instagram, uma rede social pertencente à empresa, no início de janeiro. Zuckerberg afirmou que os verificadores ‘tem sido muito tendenciosos politicamente e destruíram mais confiança do que criaram’, destacando a importância da Meta em encontrar uma solução mais eficaz.

A Meta afirma que, nos EUA, cerca de 200 mil pessoas já se inscreveram para testar as ferramentas nesta primeira fase, e as inscrições seguem abertas, segundo a empresa. No entanto, as observações feitas pelos usuários não estarão visíveis para todos imediatamente, pois a Meta começará a disponibilizá-las de forma gradual e aleatória para pessoas fora da lista de espera, levando um tempo para testar o sistema de redação e classificação antes que qualquer nota seja publicada publicamente.

Notas da Comunidade e Verificação de Fatos

A Meta não informou quando lançará oficialmente as ‘notas da comunidade’, mas disse que pretende disponibilizá-las para todos nos EUA assim que o teste beta demonstrar estar funcionando de maneira eficaz. Além disso, a empresa afirmou que, assim que as Notas começarem a aparecer publicamente, nenhum novo rótulo de verificação de fatos de checadores terceiros aparecerá nos Estados Unidos, embora eles sejam livres para se tornarem colaboradores das Notas da Comunidade junto com outros usuários de nossa plataforma. Isso faz parte do programa de verificação da Meta, que visa promover a transparência e a confiabilidade na rede social.

Para Zuckerberg, os verificadores estavam calando pessoas, e isso foi longe demais. Em janeiro deste ano, ele afirmou que o programa de verificação começou como um movimento para ser mais inclusivo, mas que tem sido cada vez mais usado para calar opiniões e excluir pessoas com ideias diferentes. A Meta acredita que as mudanças permitirão que as pessoas se expressem mais, eliminando restrições sobre alguns assuntos que são parte de discussões na sociedade, com um novo foco na moderação de conteúdo em postagens ilegais e violações de alta severidade.

Impacto na Moderação de Conteúdo

A nova política anunciada pela Meta surpreendeu alguns parceiros de verificação de fatos que colaboravam com a empresa na moderação de conteúdo, segundo a agência Reuters. Especialistas consultados alertam que a alteração na moderação de conteúdo permitirá que posts considerados problemáticos apareçam com mais frequência e permaneçam no ar sem a verificação da empresa, como desinformação sobre vacinas, Covid e eleições. A política de moderação da Meta visa equilibrar a liberdade de expressão com a necessidade de proteger os usuários de conteúdos prejudiciais.

Para Yasmin Curzi, da Universidade de Virgínia (EUA), todos os conteúdos que não podem ser compreendidos como ‘explicitamente ilegais e violações de alta severidade’ poderão aparecer, ‘compreendendo não só desinformação, mas também racismo e homotransfobia’. A Meta está ciente desses desafios e trabalha para garantir que sua plataforma seja um espaço seguro e respeitoso para todos os usuários, em conformidade com sua política de moderação e o programa de verificação.

Fonte: © G1 – Tecnologia

Comentários sobre este artigo